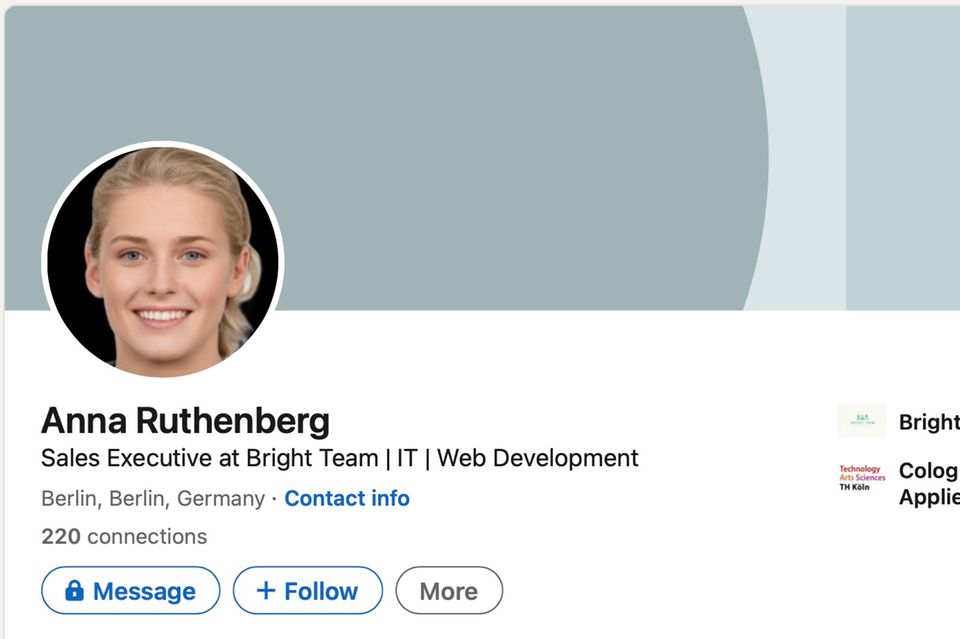

Anna Ruthenberg hat in Köln studiert, war als Freiwillige in Südafrika und arbeitet seit vier Jahren als Sales Executive bei Bright Team, angeblich ein Berliner Recruiting-Unternehmen – so steht es jedenfalls in ihrem Linkedin-Profil. Doch ihr Profilbild wurde höchstwahrscheinlich von einer Künstlichen Intelligenz (KI) erstellt. Ruthenberg hat noch nie etwas gelikt oder kommentiert und ihr Lebenslauf weist weitere typische Auffälligkeiten für ein Fakeprofil auf: vage Berufsbezeichnungen, unregelmäßige Daten, Arbeitsorte von Düsseldorf bis New York.

Linkedin ist das größte und wichtigste berufliche Netzwerk, es pflegt seinen Ruf als seriöse Plattform und sicherer Raum für den Austausch von Unternehmen und Professionals. Fakeaccounts kannte man bisher eher von Facebook oder Twitter, wo Elon Musks neues Abo-Modell für das blaue Verifikationshäkchen zuletzt für Verwirrung sorgte – längst nicht alle Prominenten oder öffentlichen Institutionen wollten für das Häkchen zahlen, andere nutzten die Möglichkeit aus, um ihr gefälschtes Profil echt erscheinen zu lassen.

Der neue Transparenzbericht von Linkedin zeigt nun aber, dass Fakeprofile auch beim inzwischen 20-jährigen Businessnetzwerk immer häufiger werden. Im zweiten Halbjahr 2022 sperrte Linkedin nach eigenen Angaben mehr als 58 Millionen Konten, im ersten Halbjahr waren es noch weit weniger als die Hälfte gewesen. Das Internet Observatory der Stanford University identifizierte in einer Studie außerdem mehr als 1000 unauthentische Profile von 63 Arbeitgebern mit Kontakten zu echten Usern, aber KI-generierten Profilbildern und gefälschten Lebensläufen.

Fakeprofile gehören oft Betrügern, aber auch Unternehmen

„Einige der Konten wurden von Drittfirmen erstellt, die Dienstleistungen zur Kontaktgenerierung anbieten“, heißt es in der Studie von Josh Goldstein und Renée Diresta. „Sie sind vergleichbar mit Marketing- oder PR-Firmen, die gefälschte Konten für Propagandakampagnen erstellen.“ Laut den Forschenden werden bei Linkedin Methoden für geschäftliche Zwecke genutzt, die sonst in politischen Desinformationskampagnen zum Einsatz kommen.

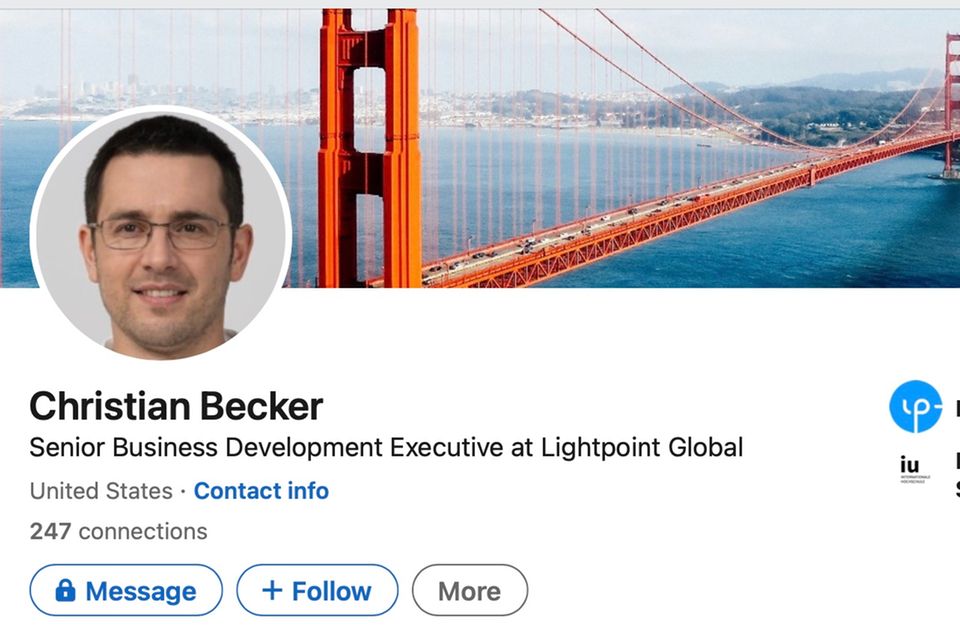

Christian Becker soll ein Bright-Team-Kollege von Anna Ruthenberg sein, laut seinem Profil arbeitet er in San Francisco und Berlin und interessiert sich für Tesla und Microsoft. Doch auch sein Profilbild wurde vermutlich von einer KI erstellt und bei genauerem Hinsehen wirft sein Lebenslauf Fragen auf. Er hat fast 250 Kontakte, auch Anna hat über 200 – Personen, die die beiden vermeintlich kennen und die ihnen mutmaßlich vertrauen. Wer aus dem eigenen Netzwerk kommt, wirkt glaubwürdiger und überzeugender.

Wenn die Geschichten plausibel erscheinen, können Unternehmen gefälschte Personen einerseits dafür nutzen, ihr Netzwerk zu erweitern und Öffentlichkeitsarbeit zu betreiben. Andererseits können sie Einblick in bestimmte Gruppen erhalten und Hintergründe über die Personen erfahren, die für sie interessant sein könnten.

Umgekehrt geben sich User aber auch selbst als Mitarbeitende von Unternehmen aus, obwohl sie es gar nicht sind. So teilte der angebliche Investment Consultant von Blackrock William Grace-Hunter in einem Linkedin-Kommentar seine Meinung zu bestimmten Emittenten und Anlagestrategien. Auf Anfrage der „Financial Times“ teilte Blackrock mit, es gebe den Titel Investment Consultant im Unternehmen gar nicht, außerdem würden solche Äußerungen bei Social Media zu disziplinarischen Maßnahmen führen, hätte es sich um einen echten Mitarbeiter gehandelt.

Linkedin will Erkennungsmethoden verbessern

„Betrüger werden immer geschickter darin, Technologie zu nutzen, um Menschen zu täuschen – in den häufigsten Fällen, um damit finanziellen Gewinn zu erzielen“, teilt Linkedin zu dem Problem auf Anfrage mit. Bisher hätten fast hundert Prozent der Spam-Profile durch automatische Schutzmechanismen erkannt und Fakeprofile blockiert werden können, bevor sie von anderen Mitgliedern gemeldet worden seien, heißt es. Doch unechte Profile von echten zu unterscheiden wird immer schwieriger, je mehr KI dazulernt. Die Stanford-Studie war bei der Identifikation von Fakeprofilen nur so erfolgreich, weil gefälschte Profilfotos derzeit oft noch fehlerhaft und mit bloßem Auge zu erkennen sind. Aber mit einer besseren KI-Leistung wird das nicht mehr ohne Weiteres möglich sein.

Darüber hinaus sind auch gefälschte Follower und Likes ein Problem. Hierzu hat die Microsoft-Tochter Anfang des Jahres einen Rechtsstreit gegen die Plattform SocialBD24 beendet, die u.a. gefälschte Follower verkauft hatte. Die Anwältin Sarah Wight schrieb dazu, man werde „weiterhin daran arbeiten, Linkedin als sichere und vertrauenswürdige Plattform zu erhalten“. Die Einleitung rechtlicher Schritte bei Missbrauch sei dabei nur eine von vielen Möglichkeiten. So hat Linkedin eigenen Angaben zufolge ein Deep-Learning-Modell entwickelt, das KI-generierte Bilder besser erkennen soll. Außerdem füge man „kontinuierlich kostenlose Verfizierungsfunktionen“ hinzu, mit denen zum Beispiel die E-Mail-Adresse überprüft werden kann.